模型类别#

首先要下载模型,Stable Diffusion模型可以在huggingface或者Civitai下载到。但是在这两个网站上下载的模型可能会有三种格式。

CoreML格式#

这种类别的模型较少,文件主要以.mlmodelc或.mlmodel为主,其文件结构大致为:

1

2

3

4

5

6

| ├── TextEncoder.mlmodelc

├── TextEncoder2.mlmodelc

├── Unet.mlmodelc

├── VAEDecoder.mlmodelc

├── merges.txt

└── vocab.json

|

Diffusers格式#

在huggingface上下载的模型大多是这种类型,其文件结构大致为:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

| ├── model_index.json

├── scheduler

│ └── scheduler_config.json

├── text_encoder

│ ├── config.json

│ └── pytorch_model.bin

├── tokenizer

│ ├── merges.txt

│ ├── special_tokens_map.json

│ ├── tokenizer_config.json

│ └── vocab.json

├── unet

│ ├── config.json

│ └── diffusion_pytorch_model.bin

└── vae

├── config.json

└── diffusion_pytorch_model.bin

|

safetensors格式#

在Civitai网站下载的大多是这种格式,就一个文件,非常方便。

模型转换#

接下来,需要把下载下来的模型都转成CoreML格式,如果你在第一步下载的模型已经是CoreML格式,那么这一步就可以跳过。

Diffusers格式转CoreML格式#

首先下载该仓库代码:ml-stable-diffusion。查看System Requirements检查自己的设备是否支持。然后安装依赖:

1

| pip install -r requirements.txt

|

找到torch2coreml.py文件,执行以下命令:

1

2

3

4

5

6

7

8

9

| python torch2coreml.py \

--bundle-resources-for-swift-cli \

--xl-version \

--convert-unet \

--convert-text-encoder \

--convert-vae-decoder \

--attention-implementation ORIGINAL \

--model-version /your/model/path \

-o /your/model/output/path

|

注意有个参数--xl-version,如果模型是sdxl类型的,就加上,否则把这行删除。另外如果你的模型支持图生图,你可以加上--convert-vae-encoder参数。

运行完该命令,应该在你指定的目录生成了文件,在Resources目录下的文件就是转换好的CoreML格式。

safetensors格式转Diffusers格式#

首先下载该仓库代码:Diffusers。然后安装依赖:

1

| pip install --upgrade diffusers

|

找到convert_original_stable_diffusion_to_diffusers.py文件并执行以下命令:

1

2

3

4

5

6

| python convert_original_stable_diffusion_to_diffusers.py \

--checkpoint_path /your/model/path \

--dump_path /your/model/output/path \

--from_safetensors \

--half \

--device mps

|

这里--half表示转换时精度为fp16,--device mps表示模型使用mps(GPU)进行推理。

运行完该命令,会生成Diffusers格式的模型,再利用Diffusers格式转CoreML格式的步骤,将模型转换为CoreML格式。

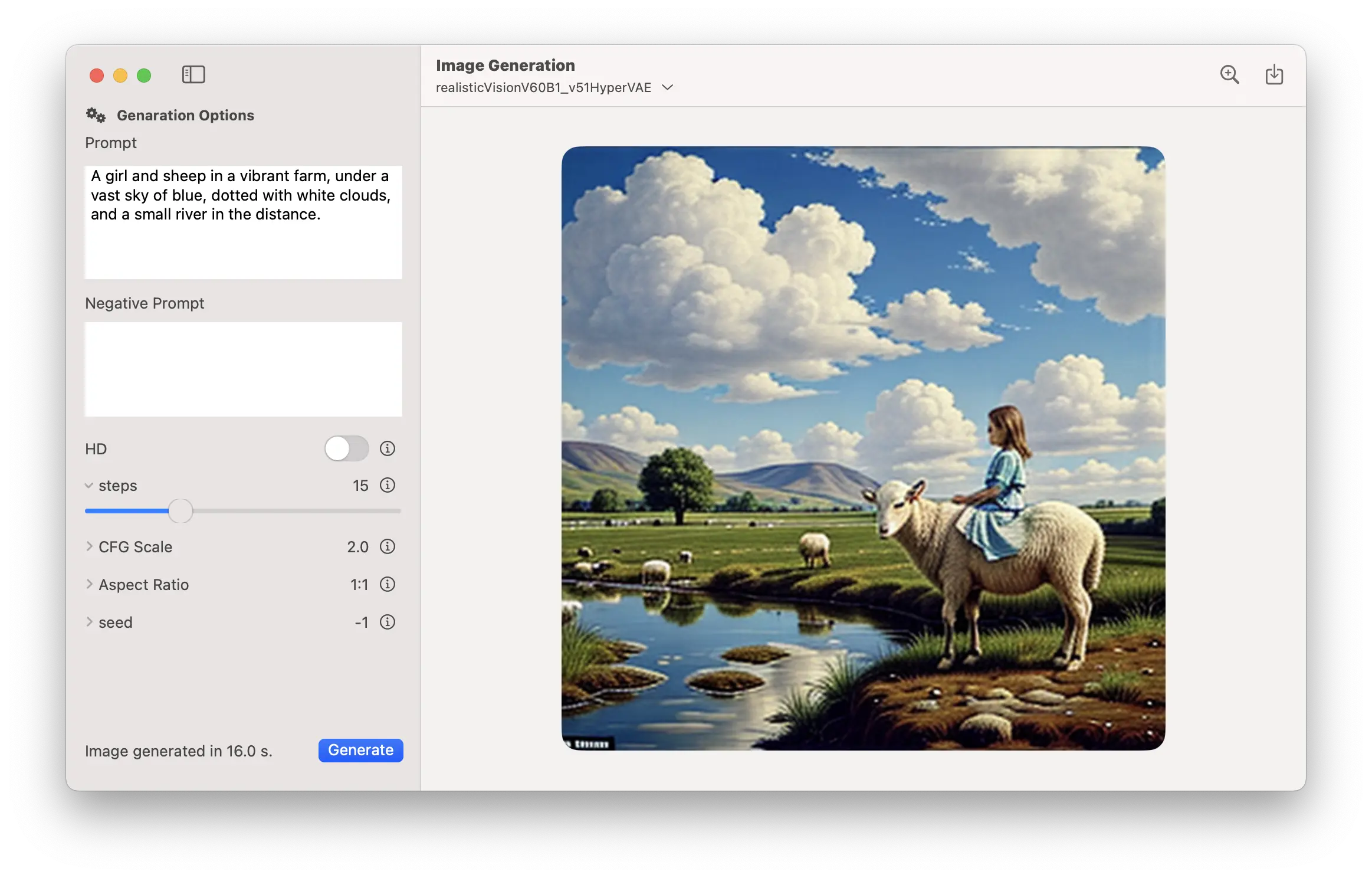

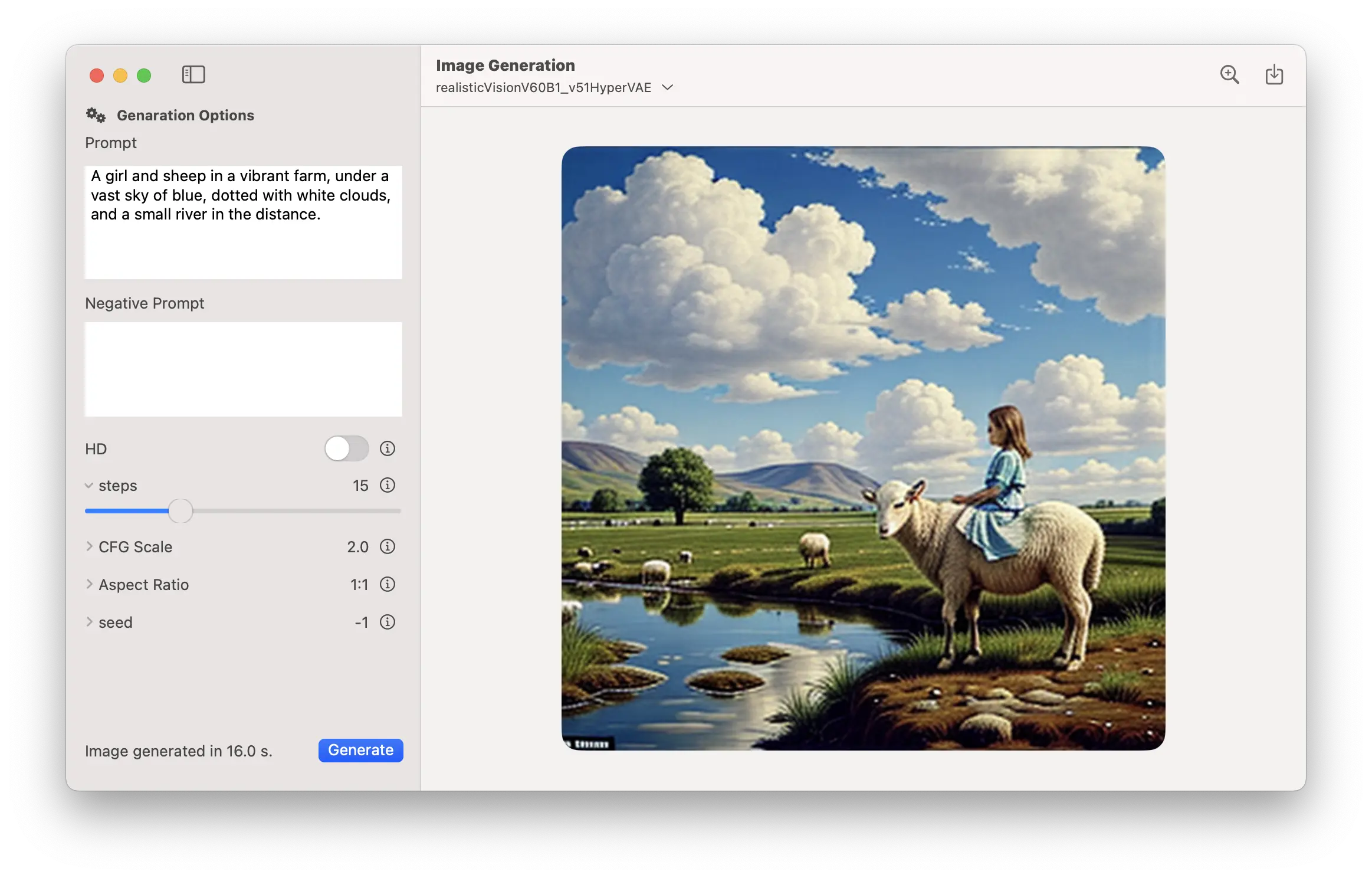

Swift调用Stable Diffusion模型#

使用Huggingface提供的swift-coreml-diffusers库。

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

| import StableDiffusion

import CoreML

// 初始化CoreML配置

let config = MLModelConfiguration()

// 运行在GPU上(MAC限定)

config.computeUnits = MLComputeUnits.cpuAndGPU

// 初始化pipeline

var pipeline = try StableDiffusionPipeline(resourcesAt: modelDirectory,

controlNet: [],

configuration: config,

reduceMemory: diffusersConfig.reduceMemory)

let pipeline.loadResources()

// 初始化图片推理配置

var pipelineConfig = StableDiffusionPipeline.Configuration(prompt: prompt)

pipelineConfig.stepCount = stepCount

pipelineConfig.guidanceScale = cfgScale

pipelineConfig.schedulerType = scheduler

// 开始图片推理

let images = try pipeline.generateImages(configuration: pipelineConfig,

progressHandler: { progress in

})

|

我的AquariusAI项目提供了示例代码。

那到底什么是CoreML呢?

Core ML 是Apple Silicon芯片产品(包括macOS、iOS、watchOS 和 tvOS)中使用的机器学习框架,用于执行快速预测或推理,在边缘轻松集成预训练的机器学习模型,从而可以对设备上的实时图像或视频进行实时预测。

Core ML 通过利用 CPU、GPU 和 神经网络引擎 ,同时最大程度地减小内存占用空间和功耗,来优化设备端性能。 由于模型严格地在用户设备上,因此无需任何网络连接,这有助于保护用户数据的私密性和 App 的响应速度。

简而言之,如果你的模型运行在Silicon芯片的苹果设备上,利用Core ML可以获得更快的性能和更低的内存及能耗。